近日,阿联酋阿布扎比技术创新研究所(Technology Innovation Institute,简称TII)发布了,阿联酋首个类ChatGPT开源大语言模型——Falcon-40B。(开源地址:https://huggingface.co/tiiuae/falcon-40b)

Falcon-40B拥有400亿参数,在1万亿tokens数据集上进行训练,可用于文本问答、总结摘要、自动生成代码、语言翻译等,支持特定业务场景微调。

在斯坦福大学的HELM LLM基准测试中,Falcon-40B比GPT-3、 Chinchilla AI、PaLM-62B等知名大语言模型的算力消耗低更低,性能却更出色。

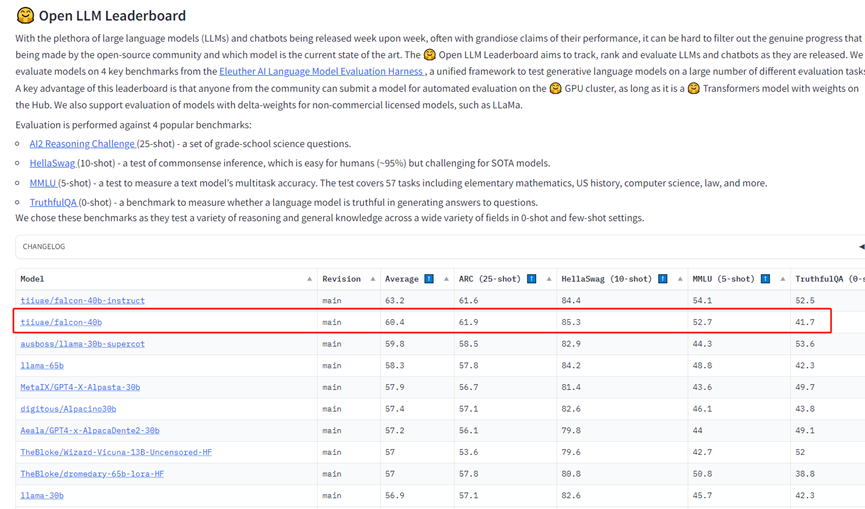

目前,Falcon-40B在huggingface的开源大语言模型排行榜中位列第一名,击败了LLaMa 65b、GPT4-X-Alpasta-30b、StableLM、RedPajama、LLaMa 30b等一系列著名开源项目成为一匹黑马。

这主要是因为TII是国家级技术研究机构,在人才、资金、算力资源方面远超企业、个人开发者属于降维打击。例如,Falcon-40B是在384个A100 40GB GPU上进行训练,一般机构根本承担不起这么大的训练费用。

TII表示,Falcon-40B允许商业化,但通过该产品每年收入超过100万美元需要与TII签订商业协议缴纳版权费。所以,业务较大的企业在使用该模型时需要慎重考虑。

Falcon-40B官方介绍

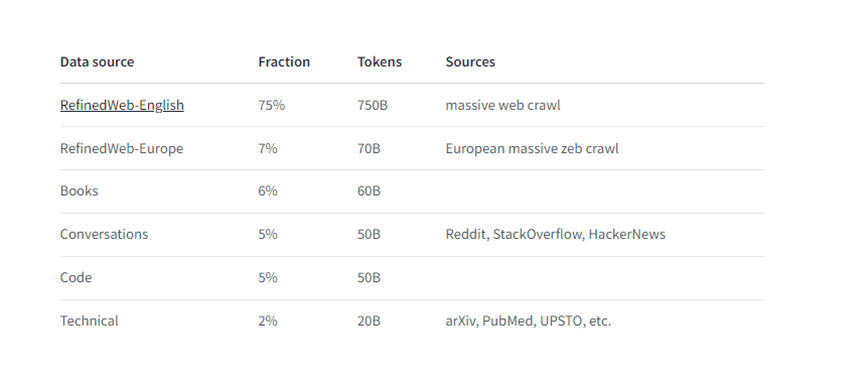

1万亿tokens数据集

Falcon-40B是在开源数据集RefinedWeb上训练而成。RefinedWeb拥有1万亿tokens,基于Apache 2.0允许商业化。(RefinedWeb开源地址:https://huggingface.co/datasets/tiiuae/falcon-refinedweb)

其中,RefinedWeb的7500亿数据源是基于英语的网页抓取;700亿来自欧洲的数据爬取;600亿是书籍;500是对话,包括Reddit、StackOverflow等;500亿是代码;200亿是技术文档,包括arXiv、PubMed、UPSTO。

所以,Falcon-40B虽然参数不高,但经过庞大的数据池洗礼后,可以精准执行文本、代码生成、智能聊天机器人等与ChatGPT类似的功能。

此外,如果开发者需要数据集进行大语言模型训练的话,也可以尝试使用RefinedWeb,以节省时间和提升开发效率。

算力消耗低,性能更强

根据TII在官网公布的数据,Falcon仅使用了 GPT-3训练计算的75%、Chinchilla的 40% 和PaLM-62B的80%,在算力方面消耗更低,但表现出的性能更加强悍。

TII表示,在开发过程中对Falcon的架构进行了大量优化,将高质量数据集与算法进行了深度融合,Falcon 仅在训练预算的75%上就明显优于GPT-3,并且在推理时只需要五分之一的算力。

这也让Falcon-40B击败了LLaMa 65b、GPT4-X-Alpasta-30b、StableLM一系列知名大语言开源项目,成为huggingface开源大语言模型排行榜中的状元。

Falcon-40B的排行榜

参与者需要经过AI2 Reasoning Challenge,一组科学问题;HellaSwag,10次常识推理测试;MMLU,57项任务测试,包括初等数学、历史、法律等;TruthfulQA,衡量语言模型在生成问题答案时是否真实的基准。

严格考验才能入选huggingface开源大语言模型排行榜。因此,Falcon-40B的推理、计算、拟人化等能力相当优秀。

TII还开源了以下项目:

Falcon-40B- instruct指令版,地址:https://huggingface.co/tiiuae/falcon-40b-instruct

Falcon-7B,地址:https://huggingface.co/tiiuae/falcon-7b

Falcon-7B-instruct指令版,地址:https://huggingface.co/tiiuae/falcon-7b-instruct

不过TII建议开发者先从Falcon-40B开始使用,这是他们目前推出最实用的版本。

关于TII

TII 成立于2020年,是阿布扎比高等教育和科技部 (ADEK) 旗下的研究机构。TII 的目标是推动科学研究、开发前沿技术并将其商业化,以促进阿布扎比和阿联酋的经济发展。

TII 目前拥有来自 74个国家的800多名研究专家,发表了 700 多篇论文和 25 多项专利,是世界领先的科学研究机构之一。

– END –

开发者大赛

报告下载

大佬观点